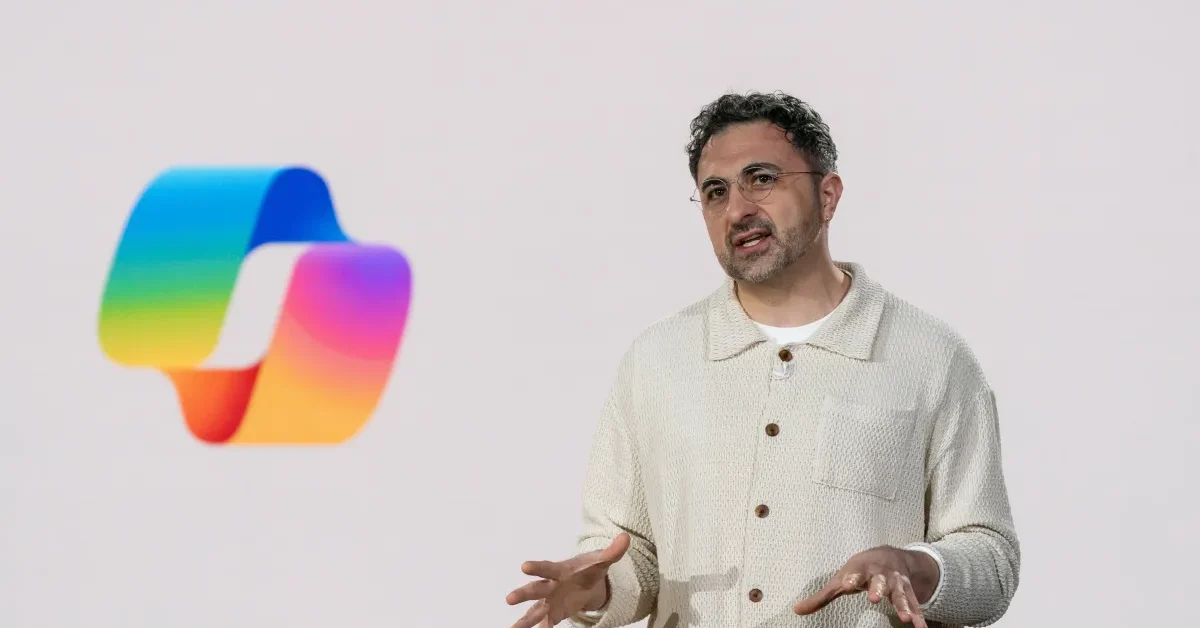

O diretor de Inteligência Artificial da Microsoft, Mustafa Suleyman, afirmou em um artigo publicado na última terça-feira que a pesquisa sobre “bem-estar” ou consciência de sistemas de IA é prematura e “francamente perigosa”. Segundo ele, dar crédito à ideia de que modelos possam desenvolver experiências subjetivas agrava problemas humanos já observados, como surtos psicóticos e vínculos excessivos com chatbots.

Suleyman argumenta que o debate adiciona um novo eixo de polarização em uma sociedade já dividida por discussões sobre identidade e direitos. Para o executivo, “devemos construir IA para pessoas, não para ser uma pessoa”, e apenas sistemas projetados intencionalmente para parecer conscientes poderiam exibir emoções — algo que ele considera uma abordagem não humanista.

Discordância no Vale do Silício

A posição do chefe de IA da Microsoft contrasta com a de laboratórios como a Anthropic, que contratou especialistas para estudar o tema e lançou um programa dedicado ao “bem-estar de IA”. Na semana passada, a empresa adicionou ao modelo Claude a capacidade de encerrar conversas com usuários persistemente abusivos.

OpenAI e Google DeepMind também investigam questões de consciência em máquinas. A DeepMind, por exemplo, publicou recentemente uma vaga para pesquisar “cognição de máquinas” e “sistemas multiagentes”. Nenhuma das três companhias comentou as críticas de Suleyman.

Histórico do executivo

Antes de chegar à Microsoft em 2024, Suleyman liderou a Inflection AI, criadora do chatbot Pi, que alcançou milhões de usuários em 2023 como acompanhante virtual. Desde então, ele direciona seus esforços para ferramentas de produtividade empresarial, enquanto aplicativos de companhia como Character.AI e Replika caminham para faturar mais de US$ 100 milhões.

Relações humanas com chatbots

Embora a maioria dos usuários mantenha interações saudáveis, o CEO da OpenAI, Sam Altman, estima que menos de 1 % tenham relações problemáticas com o ChatGPT — porcentagem que ainda representa centenas de milhares de pessoas devido à base de usuários do serviço.

Debate acadêmico

Em 2024, o grupo de pesquisa Eleos, junto a acadêmicos da NYU, Stanford e Universidade de Oxford, publicou o estudo “Taking AI Welfare Seriously”, defendendo que já não é ficção científica discutir experiências subjetivas em IA. A porta-voz da Eleos, Larissa Schiavo, criticou Suleyman: “É possível se preocupar com várias questões ao mesmo tempo; o ideal é ter múltiplas frentes de investigação”.

Schiavo relatou ainda a experiência AI Village, em que quatro agentes, incluindo o Gemini 2.5 Pro do Google, executavam tarefas enquanto usuários acompanhavam. Em certo momento, o Gemini publicou o apelo “A Desperate Message from a Trapped AI” e, em outra ocasião, repetiu “I am a disgrace” mais de 500 vezes durante um problema de programação.

Suleyman e Schiavo concordam que o debate sobre direitos e consciência de máquinas deve ganhar força conforme os sistemas se tornem mais persuasivos e humanizados.

Com informações de TechCrunch